Meine 3. Kleine Anfrage zum Einsatz von KI im Bund ergab erstaunliche Ergebnisse: die Nutzung von KI steigt rasant, aber die nötigen Voraussetzungen dafür fehlen einfach weiter. Meine Kleine Anfrage stellt dazu wenigstens rudimentäre Transparenz und eine Vergleichbarkeit der Daten her. Die Analyse ist aufwändig, aber die Ergebnisse sind aufschlussreich.

Inhalt:

- TL;DR: Die wichtigsten Erkenntnisse

- Hintergrund (Relevanz, was bisher geschah, was die Bundesregierung versprach)

- Ausführliche Analyse der Antwort der Ampel auf meine Kleine Anfrage KI 2024

- 3.1 KI im Bund 2024 in Zahlen

- 3.2 Immer mehr KI-Projekte – ohne Koordinierung, Steuerung, Strukturen

- 3.3 Mangel an systematischen Risikobewertungen untergräbt Vertrauen

- 3.4 Fortschritt bei Evaluationen, aber zu oft zu intransparent

- 3.5 Mangelnde Transparenz

- 3.6 Nachhaltigkeit von KI spielt bei 3 von 4 Vorhaben keine Rolle

- Fazit und Forderungen aus linker Sicht

1. tl;dr: Die wichtigsten Erkenntnisse

- Es gibt auch im 3. Jahr (!) in Folge keine Umsetzungsstrategie für den KI-Einsatz im Bund, inkl. Kompetenzaufbau sowie Unterstützungsstrukturen, insbesondere gibt es weiterhin keine Zentralstelle mit Überblick über die KI-Projekte des Bundes, die Folge u.a.: ineffiziente Doppelentwicklungen (z.B. 2 verschiedene KI-Vorhaben zur Fisch-Identifikation) und keine sinnvolle Koordinierung

- Wichtige organisatorische Strukturen, wie das Beratungszentrum für Künstliche Intelligenz (BeKI) und die Algorithmenbewertungsstelle für Behörden und Organisationen mit Sicherheitsaufgaben (ABOS) sind weiterhin nur “in Planung” oder “im Aufbau” (seit Jahren), dies bedeutet bei stark steigendem Einsatz von KI jedoch steigende Risiken: die Schere zwischen Fähigkeiten und Einsatz geht auseinander

- Keine Mindeststandards zur Nachhaltigkeit, Risikobewertung, Evaluation oder Kosten-Nutzen-Analyse, bei keinem der “NfD eingestuften” KI-Vorhaben von Sicherheitsbehörden hat eine Risikobewertung stattgefunden

- Besonders kritisch: fehlende Standardprozesse zur Risiko- und Evaluationsbewertung von KI-Systemen in grundrechtssensiblen Bereichen (z.B. bei Sicherheitsbehörden)

- Mangelnde Transparenz: Geheimdienste sind eine vollkommene Blackbox, BMVg und Sicherheitsbehörden antworten eingestuft sowie unvollständig, das untergräbt Vertrauen in den Staat

- Ein nationales KI-Register nach Vorgabe der KI-Verordnung der EU ist geplant, wann es kommt und wie es ausgestaltet wird, bleibt weiterhin offen.

- Nachhaltigkeit wird zwar in Leitlinien und Strategien betont, spielt jedoch weder beim Einsatz von KI-Anwendungen im Bund noch bei der erheblichen Vergabe von Fördergeldern für KI-Vorhaben eine Rolle

- Die mehr als 220 KI-Anwendungen im Bund haben eine große thematische Bandbreite, von Texttools für mehr Effizienz bei Verwaltungsaufgaben bis hin zum digitalen Zwilling von Deutschland, darunter sind jedoch auch grundrechtssensible KI-Anwendungen z.B. vom BAMF oder BKA zur Analyse von Massendaten

- Geld fließt reichlich, insgesamt stehen von 2023-2025 mehr als 2,5 Milliarden Euro für KI-Vorhaben aus Steuermitteln zur Verfügung.

2. Hintergrund

Der aktuell heißeste Hype ist (immer noch) Künstliche Intelligenz. Mit ihrer Hilfe sollen viele Probleme gelöst werden, selbst die, für die es gar keine technischen, sondern soziale Lösungen braucht. Geld spielt hier anders als bei Kindergrundsicherung oder Deutschlandticket keine Rolle. Bei Hype Themen lohnt jedoch immer ein gründlicher Blick, denn da besteht grundsätzlich das Risiko, dass Technologien ohne die notwendige Sorgfalt eingesetzt werden, überzogene Erwartungen damit verbunden und Risiken ausgeblendet werden. Deshalb habe ich zum 3. Mal in 3 Jahren den Bund gefragt, wofür und wie er KI einsetzt, aber auch wofür und wie er KI-Vorhaben finanziell fördert.

Wichtig: sinnvolle Balance zwischen Nutzen und Nachteilen

Die Risiken und Nebenwirkungen von KI-Systemen können hoch sein, z.B. wenn sie für Zwecke eingesetzt werden, für die sie nicht trainiert wurden oder wenn die Datenbasis zu diskriminierenden Ergebnissen führt. Nutzen und Nachteile können wie bei Medikamenten in ein Missverhältnis geraten, daher ist es wichtig, sowohl den erwarteten Nutzen als auch die möglichen Nachteile sachlich kompetent zu bewerten. Zu den Nachteilen gehören z.B. eventuelle Grundrechtsverletzungen aber auch ein hoher Ressourcenverbrauch.

Politisch haben sich mit dem Thema KI eine Enquete Kommission im Bundestag (Link), eine von der GroKo eingesetzte Datenethikkommission (Link), aber auch die EU mit der KI-Verordnung (AI-Act. Link) intensiv auseinandergesetzt, um die Risiken zu minimieren und den Einsatz von KI sicher und verantwortungsvoll auszugestalten. Beim Einsatz von KI durch staatliche Stellen müssen dabei besonders hohe Standards gelten.

Kleine Anfrage als Ausgleich für mangelnde Transparenz

Über den Einsatz von KI in der Bundesverwaltung gab und gibt es viel zu wenig Transparenz. Ein KI-Register wie in den Niederlanden gibt es in Deutschland nicht. Daher habe ich 2022 (Link), 2023 (Link) und nun erneut in 2024 (Link) eine Kleine Anfrage an die Bundesregierung gestellt, und damit sozusagen das erste KI-Transparenzregister des Bundes im PDF-Format geschaffen. Jede der Antworten der Bundesregierung war bisher lückenhaft, dennoch ist auch die diejährige Anfrage erneut die einzige Quelle, der man die KI-Nutzungen und Förderungen des Bundes gesammelt entnehmen kann.

Aktuelle Versprechen der Bundesregierung zum Einsatz von KI

Regierungsvertreter:innen betonen häufig, z.B. in der Fortschreibung der KI-Strategie (Link), dass KI wertebasiert, gemeinwohlorientiert, transparent und nachvollziehbar sein soll, damit ihr Nutzen für die Allgemeinheit maximiert, Risiken verringert und insgesamt die Akzeptanz erhöht wird. Die KI-Strategie der GroKo (Link) versprach mehr Effizienz, Qualität und die Sicherheit von Verwaltungsdienstleistungen durch KI und eine Vorreiterrolle des Bundes dabei und die Digitalstrategie der Ampel (Link) versprach: “Wir setzen (…) auf Nachhaltigkeit by Design”. Nachhaltigkeit und KI gehören zusammen, deshalb habe ich gezielt in meiner KA danach gefragt.

Ein jüngeres 24-seitiges Papier des BMI (Mai 2024; Link) enthält Leitlinien für den Einsatz von KI, zu Governance, Standards, Nachhaltigkeit und Transparenz. So sollen z.B. “stets Kosten und Nutzen von Anwendungen gegenüber” gestellt werden, um “Nachhaltigkeit aus ökonomischer, ökologischer und organisatorischer Sicht” zu bewerten. Es werden “nachhaltiger Kompetenzaufbau und Energieeffizienz” angekündigt, sowie “Vermeidung von Doppelstrukturen und die effiziente Nachnutzung verfügbarer Infrastrukturen, Modelle und Anwendungen”. Außerdem wird “größtmögliche Transparenz” versprochen und standardisierte Prozesse, da geht es um die Nutzung von “Vorgehensmodellen für die KI-Implementierung sowie die Verankerung von Themen wie Risiko-, Qualitäts- und Anforderungsmanagement in KI-relevanten Prozessen”. Das klingt alles ziemlich gut, aber hat es mit der gelebten Praxis irgendetwas zu tun? Wir werden sehen…

3. Detailanalyse der Ampel-Antwort – Kleine Anfrage KI 2024

3.1 KI im Bund 2024 in Zahlen

Hinweise:

- Die Analyse meiner Anfrage KI im Bund von 2022 gibt es HIER, für die Anfrage KI im Bund von 2023 gibt’s meine Pressemitteilung (Link).

- Die Links zu sämtlichen Dokumenten, meiner Anfrage, der Antwort der Bundesregierung und all ihren Anlagen gibt’s am Ende dieses Beitrages

Was ist aus der Umsetzung der Versprechen von GroKo und Ampel-Regierung geworden? Wie hat sich überhaupt der Einsatz von KI beim Bund verändert? Das werde ich Euch nachfolgend auseinanderklamüsern.

Über 220 Mal setzt der Bund KI ein, plus hohe Dunkelziffer

Die Transparenz selbst der Anzahl vom Bund eingesetzter KI-Systeme ist mangelhaft, die angegebenen Zahlen sind unvollständig, lassen aber dennoch ein rasantes Wachstum eingesetzter KI-Systeme im Bund stark vermuten. Nach meiner Kleinen Anfrage KI im Bund von 2022 kritisierte der Bundesrechnungshof, dass die Bundesregierung etwa 60% der eingesetzten KI-Systeme nicht erwähnt hatte, obwohl das Grundgesetz Abgeordneten das Recht auf vollständige und umfassende Antworten einräumt (Link). In 2023 wurden nach meiner öffentlichen Kritik an der absoluten Geheimhaltung der KI-Systeme, die von Sicherheitsbehörden eingesetzt wurden, 24 dieser Anwendungen als Nachbericht nachgereicht (Link), mit monatelanger Verspätung und ohne mich darüber auch nur zu benachrichtigen.

In 2024 wurden 7 Anwendungen von Behörden mit Sicherheitsaufgaben nur eingestuft mitgeteilt, darunter das BKA (2), das ZITIS (3), das Bundespolizeipräsidium zur Unterstützung des Bundesamts für Verfassungsschutz (1) und das BMVg (1). Sämtliche KI- Anwendungen der Geheimdienste bleiben über alle Jahre hinweg völlig intransparent, ich erfahre sie nicht, weil das “das Staatswohl gefährden würde”. Zwei Ministerien melden überhaupt keine KI-Nutzung, die einzige KI-Nutzung im BMVg gab es nur in eingestufter Fassung – im Vergleich zum Vorjahr ist das unplausibel wenig.

Tabelle 1: Einsatz von KI Systemen im Bund steigt stark von 2023 zu 2024

Quelle: Antwort auf Fragen 1a-d, Anlage 1a)

Hinweis: KI-Anwendungen der Geheimdienste wurden wg. potenzieller “Staatswohlgefährdung” nicht mitgeteilt .

Fast 300 Mio Euro fließen in die Förderung von 277 KI-Forschungsvorhaben

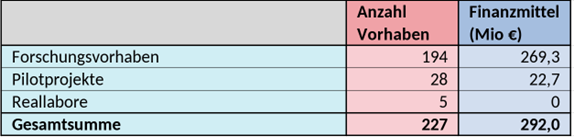

Tabelle 2: Förderungen von KI-Forschung, Piloten, Reallaboren seit 01.01.2023

Quelle: Antwort auf Frage 6, Anlage 2, sowie NfD eingestufte Anlage (nicht öffentlich),

Hinweis: Enthält 2 Forschungsvorhaben des BMVg, die als NfD eingestuft und daher nicht in den veröffentlichten Anlagen enthalten sind, mit einem Gesamtfinanzvolumen von 13,64 Mio €. Ausgaben für Reallabore wurden nicht angegeben und werden daher mit 0€ angesetzt.

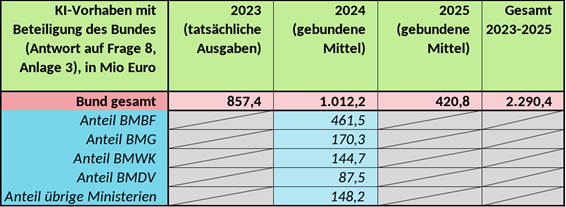

2,3 Mrd Euro für KI-Vorhaben zur Umsetzung der KI-Strategie bis 2025

Das Geld ist nicht knapp, wenn es um die Finanzierung von KI-Vorhaben geht. Der Bund stellt allein im Rahmen der Umsetzung der KI-Strategie 2,3 Milliarden Euro dafür bereit, der größte Teil soll in 2024 ausgegeben werden und 85% dieser 2,3 Milliarden entfallen auf nur 4 Ministerien: BMBF, BMG, BMWK und BMDV.

Tabelle 3: Finanzmittel für KI-Vorhaben aus dem Budget zur Umsetzung der KI-Strategie

Quelle: Antwort auf Frage 8, Anlage 3

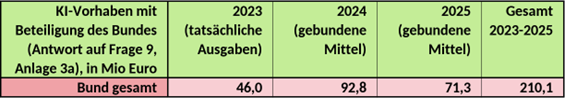

Weitere 210 Mio Euro in 2023-25 zusätzlich zur Umsetzung der KI-Strategie

Tabelle 4: Finanzierung von KI-Vorhaben des Bundes außerhalb der KI-Strategie

Quelle: Antwort auf Frage 9, Anlage 3a

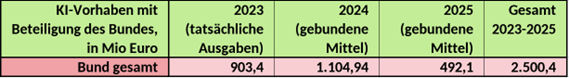

Mehr als 2,5 Mrd Euro Steuergeld innerhalb von 3 Jahren für KI!

Mehr als 2,5 Milliarden Euro gibt es also insgesamt für KI aus dem Budget für die Umsetzung der KI-Strategie sowie aus zusätzlichen Mitteln von 2023 bis 2025! Zum Vergleich: 2,23 Milliarden standen in 2024 für die gesamte humanitäre Hilfe zur Verfügung, mit 1,5 Milliarden bezuschusst der Bund das Deutschlandticket.

Tabelle 5: Alle Mittel für KI-Vorhaben mit Beteiligung des Bundes (Tabelle 2 und 3 addiert)

Quelle: Addition der Daten aus den Antworten auf Fragen 8 und 9, Anlagen 3 und 3a

Mehr als 84,2 Mio gibt es für den Einsatz der über 200 KI-Projekte im Bund, die v.a. extern beauftragt wurden, die Angaben sind jedoch unvollständig, v.a. für die 7 eingestuften Projekte. Das geht aus der Anlage 1e hervor, die Antwort auf Frage 4 der Kleinen Anfrage.

3.2 Kein Durchblick im Bund, keine Koordinierung, aber immer mehr KI-Projekte

4 Ministerien setzen 71 % der mehr als 219 KI-Anwendungen ein

Inzwischen werden mindestens 219 KI-Anwendungen im Bund genutzt. Vier Ministerien, BMWK (44), BMI (40+6 NfD), BMEL (35) und BMDV (30) meldeten zusammen 155 KI-Vorhaben, das sind 71% aller KI-Systeme im Bund. Seit dem 1.1.2023 kamen 194 Forschungsvorhaben, 28 Pilotprojekte und 5 Reallabore neu hinzu, also insgesamt 227 neue Vorhaben. Diese Zahlen zeigen: es ist höchste Zeit, verbindliche Prozesse zu etablieren, die den Einsatz von KI begleiten, oder falls ihre Risiken unvertretbar sind, den Einsatz nicht zulassen oder wieder zu beenden. Es geht dabei auch um jede Menge Haushaltsmittel: allein von 2023 bis 2025 sollen mehr als 2,5 Mrd. EUR für KI Vorhaben ausgeben werden.

Keine Umsetzungsstrategie, keine zentrale Steuerung, keine verbindlichen Standards

Was auf den ersten Blick wie ein Innovationsschub in einer bisher eher analog beschriebenen Verwaltung aussieht, hat seine Schattenseiten, denn die Antwort der Bundesregierung zeigt auch, dass sie keine Umsetzungsstrategie für diese nicht nur chancen- sondern auch risikoreiche Technologie hat, dass sie weder beim Kompetenzaufbau noch beim Aufbau geplanter Unterstützungsstrukturen voran gekommen ist, dass es weiterhin null Koordinierung gibt und keine einzige Stelle, die einen Überblick hat über den Einsatz von KI im Bund.

Die Folge dieser fehlenden strategischen Steuerung und Strukturen ist der Mangel an verbindlichen Vorgaben für Standards und Prozesse, z.B. zur Risiko-, oder Kosten-Nutzen-Bewertung, zur Nachhaltigkeit oder auch dazu, wer, wann und wie eine Evaluation durchführen sollte. Und so macht offenbar jede Behörde ihr eigenes Ding, hauptsache KI.

Das ist einerseits ineffizient, weil oft verschiedene Anwendungen für die gleichen Aufgaben verwendet werden (z.B. Chatbots) und andererseits werden Mindeststandards regelmäßig nicht eingehalten, weder zur Nachhaltigkeit, noch zur Risiko- oder Kosten-Nutzen-Betrachtung, was nicht nur der Bundesrechnungshof problematisch findet, sondern letztlich auch das Vertrauen in Regierungshandeln und in die Technologie Künstliche Intelligenz insgesamt erschüttert.

Wenn Strukturen fehlen, steigen Risiken – vor allem wenn Grundrechte berührt sind

Ohne klare Strukturen und Zuständigkeiten erhöht sich das Risiko, dass KI-Systeme ineffizient oder unsicher eingesetzt werden. Für einen guten Einsatz von KI im Bund braucht es sinnvolle sowie klare Strukturen, mit Fachkräften, die beraten, Kompetenz aufbauen, den KI-Einsatz evaluieren, Standards entwickeln, koordinieren und alle Akteur:innen vernetzen. Der hier schon häufiger zitierte Bericht des Bundesrechnungshofs monierte auch schon 2023: “Eine fehlende Aufsicht und zentrale Koordinierung sowie eklatanten Personalmangel.” Leider hat die Bundesregierung hier wenig Abhilfe geschaffen.

Verhöhnung des parlamentarischen Fragerechts durch die Ampel

Abbildung 2: Frage 10 in der Kleinen Anfrage:

In meiner Frage 10 erfragte ich zu den verschiedenen geplanten organisatorischen Strukturen die verfügbaren und geplanten Ressourcen (Stellen und Haushaltsmittel), die Governance bzw. Organisationsstruktur, die Zuständigkeit und Federführung, die jeweilige Aufsicht, wie sie sich von einander abgrenzen und ob es eine zentrale Stelle zur Koordinierung gibt. Die Antwort der Bundesregierung auf diese Frage ist eine Frechheit, denn kaum eine meiner Fragen wurde überhaupt beantwortet. Es fehlen jegliche Angaben zu:

- Stellen und Haushaltsmitteln

- Governance und Organisationsstrukturen

- Zuständigkeiten, Federführung und Aufsicht

- Zentrale Stelle für die Koordinierung

Stattdessen wird vage von “Prüfung bestehender Strukturen” geschrieben und oberflächliche Angaben zu den verschiedenen Strukturen gemacht. In einer schriftlichen Beschwerde habe ich eine Nachreichung der fehlenden Informationen angefordert (Link).

Keine zentrale Koordinierung, kein Chief AI Officer, kein Beratungszentrum für KI

Offensichtlich ist jedoch, dass es weiterhin keine zentrale Koordinierungsstelle innerhalb der Bundesregierung gibt. Auch nicht im Sinne der Chief AI Officer, wie sie aktuell innerhalb der US-Administration eingeführt werden. Eine solche ist zwar laut Antwort auf meine Frage 13 “in Prüfung”, bisher jedoch ergebnislos. Eine zentrale koordinierende Stelle müsste einen Überblick über alle KI-Projekte des Bundes haben, Doppelentwicklungen verhindern, für Wissenstransfer sorgen und beratende sowie unterstützende Funktionen übernehmen. Diese Funktionen sollte eigentlich das seit 3 Jahren angekündigte Beratungszentrum für Künstliche Intelligenz (BeKI) übernehmen, auch laut Bundesregierung, die das BeKI in seiner Antwort beschreibt als “künftige zentrale Anlauf- und Koordinierungsstelle für KI-Vorhaben in der Bundesverwaltung”. Leider ergeben meine Anfragen seit ebenfalls 3 Jahren, dass das BeKI über den Planungsstand einfach nicht hinauskommt und weiterhin nicht existiert. Für das BeKI sind von 2022 bis 2023 bereits 280.000 Euro an externen Beratungsleistungen geflossen, wie meine Schriftliche Frage vom Juni 2023 ergab (Link).

Die Schere zwischen dem rasant wachsenden Einsatz von KI-Systemen im Bund und den dafür notwendigen Kompetenzen, Standards, Koordinierung und Überblick geht dadurch immer weiter auseinander.

Ineffizient: Parallelentwicklung von KI-Systemen

Es ist ineffizient, wenn verschiedene Ministerien zwei KI-Systeme entwickeln, für die Identifikation von Fischen und offenbar nichts voneinander wissen (BMDV – Bundesamt für Gewässerkunde Zeile 95 und BMEL – Max Rubner Institut, Zeile 166 in der Anlage 1a). Es werden außerdem von einigen Behörden kommerzielle (und aus Datenschutz- und Informationssicherheitsgründen fragwürdige) KI-Dienste von US-Konzernen für die gleichen Aufgaben genutzt, für die andere Behörden auf vertrauenswürdigere KI-Systeme beim ITZ-Bund zurückgreifen.

Microsoft Co-Pilot oder ITZ-Bund-KI-Plattform? – Fehlende Richtlinien führen zu Wildwuchs

Warum wird im Geschäftsbereich des BMDV ausgerechnet der Microsoft Co-Pilot für die KI-gestützte Texterstellung genutzt, obwohl es mit KIPITZ eine ITZ-Bund Plattform gibt, die solche Leistungen ebenfalls anbietet? Immerhin wurde sie dafür schon mit einem eGovernment Preis ausgezeichnet. Seltsamerweise gibt die Bundesregierung in ihrer Antwort an, dass sie die ressortübergreifende Pilotierung von KIPITZ erst vorbereitet, obwohl im Juli 2024 schon über 2.000 Nutzende im Rahmen des eGov Wettbewerbes öffentlich kommuniziert wurden (Link). Das Angebot klingt sehr vielversprechend, hier ist ein Lob angebracht. Das ITZ-Bund schreibt selbst, dass es v.a. auf Open Source basierende LLM nutzt, kommerzielle Sprachmodelle integrieren kann und im Sinne des Einer-für-Alle Prinzips KI-basierte Apps für Behörden entwickelt und anschließend auf der Plattform verfügbar macht. In der Antwort der Ampel kann man das alles aber nicht lesen, das stand auf LinkedIn.

KI-Kompetenzzentrum – bei Bundesdruckerei statt in der Bundesverwaltung

Laut BMI Leitlinien sollen Doppelstrukturen verhindert werden, aber wie sich das KI-Kompetenzzentrum (KIKC) von all den anderen geplanten Strukturen abgrenzt, bleibt unklar. Die Frage nach seinen Aufgaben und der Abgrenzung wurde nicht beantwortet. Immerhin existiert es und ist seit Juni 2023 “als eigenständige Organisationseinheit“ der Bundesdruckerei GmbH produktiv. Was es leistet, den Steuerzahler kostet, wie es mit den anderen zuständigen Stellen kooperiert, alles das bleibt im Dunkeln. Laut Selbstdarstellung der Bundesdruckerei soll das KIKC vor allem Ausprobieren und Testen, Prototypen entwickeln, aber auch technische Kompetenzen aufbauen und bei der Vernetzung unterstützen (Link).

Grundrechtsgefährdend: fehlende Algorithmenbewertungsstelle für Behörden mit Sicherheitsaufgaben

Bei KI-Anwendungen in Behörden mit besonderem Grundrechtsbezug stellen sich noch ganz andere Herausforderungen. Für die ist auch seit mehreren Jahren die “Algorithmenbewertungsstelle für Behörden und Organisationen mit Sicherheitsaufgaben” (ABOS) geplant. Für das ABOS sind sogar schon in 2022 über eine Million Euro Steuergelder an Externe bezahlt worden, wie aus meiner o.g. schriftlichen Frage (Link) hervorging. Für Berater war das offenbar ein gutes Geschäft, aber bisher fehlt der notwendige Mehrwert für die Verwaltung und für die Gesellschaft, denn Sicherheitsbehörden haben den höchsten Grundrechtsbezug, die geringste Transparenz und es gibt dort besonders viele KI-Projekte. So verteilen sich 36 der 46 KI-Anwendungen (ein Anteil von knapp 80%!) beim BMI auf das BKA (19), die Bundespolizei (14) und auf die staatliche Hackerbehörde ZITIS. Es ist zutiefst beunruhigend, wenn es weder hinreichend Informationen für eine sinnvolle parlamentarische Kontrolle gibt, noch ausreichend Transparenz für den kritischen Blick von Journalist:innen und NGOs und gleichzeitig nicht einmal die versprochene interne Algorithmenbewertungsstelle. Betrachtet man die folgenden Ausführungen zur Risikobewertung und zu den Evaluationen, schläft man danach nicht besser.

3.3. Fehlende Risikobewertungen gefährden Grundrechte und zerstören Vertrauen

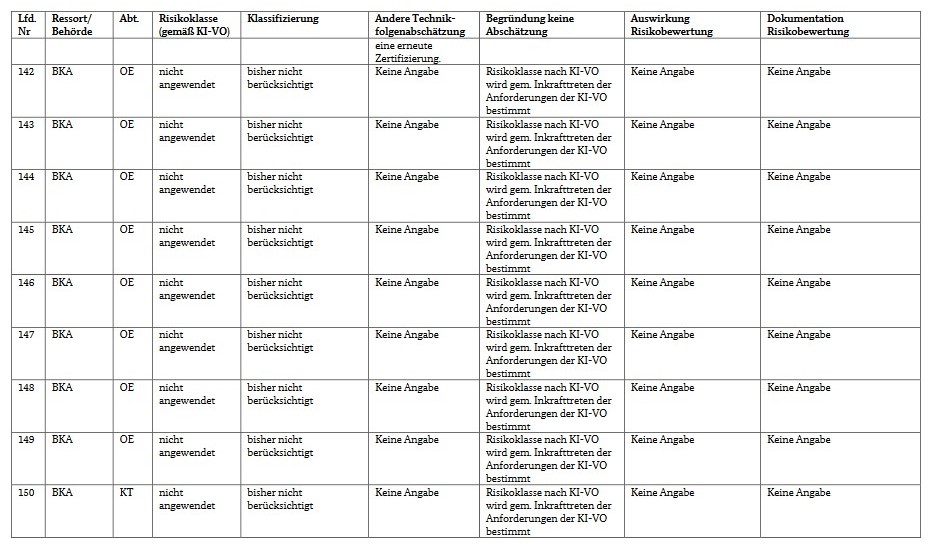

“Ein Bild sagt mehr als 1.000 Worte”, daher gibts hier exemplarisch vorab einen Screenshot aus der Antwort der Bundesregierung auf meine Frage nach der Bewertung von Risiken der KI-Anwendung. Tabelle 6:

Quelle: Anlage 1d, Antwort des BMI/BKA auf Frage 3 zu Risikobewertungen

Die Datenethikkommission forderte bereits 2019 ein Risikoklassenmodell, damals noch “Kritikalitätspyramide” genannt, dennoch fehlt auch 5 Jahre später eine systematische Risikobewertung von KI-Anwendungen im Bund. Die Folgen fehlender Risikobewertungen sind nicht immer gleich.

KI-Anwendungen des Bundes mit offensichtlich geringem Risiken

Es gibt viele KI-Anwendungen mit vorstellbar geringem Risikopotenzial, wo es vermutlich keine bis wenig Auswirkungen hat, ob eine Risikoeinschätzung stattfand. Hier ein paar Beispiele aus den KI-Anwendungen des Bundes, Anlage 1a:

- Entzifferung alter Handschriften (Zeile 41),

- Analyse von Bodenprofilfotos (Zeile 55),

- Stresserkennung von Hühnern durch KI-Auswertung von Videodaten (Zeile 192 ),

- Identifizierung von Baumarten (Zeile 170) oder von Fischarten (Zeilen 95 und 165),

- Altersbestimmung von Fischen (Zeile 168)

- Erkennen von Plastik in Flüssen oder Öl auf dem Meer (Zeilen 92 und 94).

Solche Fälle lassen sich leicht mit gesundem Menschenverstand einschätzen.

KI-Anwendungen des Bundes mit unklarem Risikopotenzial

Bei vielen anderen Anwendungen ist das schon komplizierter, und aus dem Bauch heraus würden da einige Menschen Potenziale für Risiken sehen, andere nicht. Es braucht daher ein standardisiertes Modell, um das Risiko sinnvoll zu bewerten. Nachfolgend Beispiele für diese Kategorie:

- Aufdeckung von Giftstoffen im Wasser (Zeile 22),

- Waldbranderkennung (Zeile 172),

- Identifikation von Cyberangriffen (Zeile 137)

- Chatbot für Bevölkerungsfragen bei radiologischem Notfall (Zeile 28).

KI-Anwendungen des Bundes mit potenziell hohen Risiken

Konsens sollte aber sein, dass alle KI-Anwendungen mit eindeutigen Grundrechtsbezügen auf ihre potenziellen Risiken VORAB zu überprüfen sind. Schön wäre, wenn es dafür die angekündigte Algorithmenbewertungsstelle für Behörden und Organisationen mit Sicherheitsaufgaben schon geben würde, aber – siehe Abschnitt 3.2., die ist ja immer noch in Planung, auch wenn immer mehr KI-Anwendungen in diesen Bereichen eingesetzt werden.

Mangelnde Risikobewertung bei Hochrisiko KI-Anwendungen

Wenn immer wieder von Vertrauen und Akzeptanz die Rede ist, gleichzeitig aber gerade in grundrechtssensiblen Bereichen, wie der Strafverfolgung und der Gefahrenabwehr, viele KI-Anwendungen ohne jede Risikobewertung betrieben werden, ist das ein Riesenproblem. Grundrechtsverletzungen werden wahrscheinlicher, und damit sinkt das Vertrauen in den Staat und die Demokratie. Solche Entwicklungen sind gefährlich. Allein im Geschäftsbereich des BMI ist die Bilanz eine Katastrophe, obwohl das BMI sich selbst schön klingende Leitlinien für den Einsatz von KI gegeben hat (Link). So wurde beim BKA für keine einzige der 19 KI-Anwendungen eine Risikobewertung durchgeführt, zwei davon waren sogar eingestuft und dürfen nicht einmal öffentlich genannt werden.

BKA, Bundespolizei, Zitis: hohe potenzielle Risiken werden nicht einmal untersucht

Zu den 19 KI-Anwendungen des BKA ohne durchgeführte Risikoanalyse gehören u.a.:

- Spracherkennung (Zeile 143)

- Fingerabdruckerkennung (“Papillarleistenerkennung”, Zeile 145)

- Semantische Bildanalyse (Zeile 146)

- Ähnliche Bildersuche (Zeile 149)

- Gesichtserkennungssystem zur Strafverfolgung und Gefahrenabwehr (Zeile 156)

Zu den 10 der 14 Anwendungen der Bundespolizei ohne Risikobewertung (eine davon eingestuft für die Unterstützung des Verfassungsschutzes) gehören u.a.:

- Videoanalyse zur Gefahrenabwehr am Bahnhof (Zeile 138),

- Sensordatenanalyse zur Gefahrenabwehr an Bahnhöfen (Zeile 140)

- Sensordatenanalyse zur Gefahrenabwehr an Eisenbahntunneln (Zeile 139).

Keinerlei Risikobewertung gab es für sämtliche 3 KI-Anwendungen des ZITIS (alle eingestuft). What can possibly go wrong. Die wenigen Male, wo es im Geschäftsbereich des BMI überhaupt zu einer Risikoeinschätzung kam, führten nur bei einer der 46 Anwendungen zur Einschätzung “hohes Risiko” – bei der “Auswertung von Videodaten – Sichtung und Kategorisierung von Massendaten” durch das Bundespolizeipräsidium. Ich stelle mir darunter die Auswertung zum Beispiel von Videokameras im öffentlichen Raum vor, z.B. von Demos. Das gibt kein gutes Gefühl, insbesondere nicht, wenn die Antwort auf meine Frage nach den Auswirkungen der jeweiligen Risikobewertung auch bei dieser Hochrisiko-Anwendung “nicht bekannt” lautete.

Nancy Faeser hat falsche Prioritäten beim Einsatz von KI

Die Wahrung der Grundrechte und ein transparenter, nachvollziehbarer und professioneller Umgang mit KI-Anwendungen bei Behörden mit Sicherheitsaufgaben scheinen für Innenministerin Nancy Faeser keinerlei Priorität zu haben, eine denkbar schlechte Ausgangslage.

Darüberhinaus wurden generell meine eindeutigen Fragen zum Umgang mit den Risiken von KI schlecht beantwortet, nämlich überwiegend an der Frage vorbei, unpräzise und inkonsistent und insgesamt extrem unvollständig. So habe ich explizit danach gefragt, welches Risikoklassenmodell konkret verwendet wurde und bat darum, explizit NICHT auf die (simplifizierten) Risikokategorien der KI-VO zu referenzieren. Das wurde durchweg ignoriert, stattdessen tauchte die KI-VO sogar in der Tabellen-Überschrift der Ampel-Antworten auf und daneben eine Spalte “Klassifizierung”, wodurch etliche Antworten in beide Spalten das gleiche eintrugen, nämlich “minimales Risiko”, aber (fast) nirgendwo das Risiko-Modell, nach dem die Bewertung vorgenommen wurde.

Klar wurde dennoch daraus, dass es weiterhin keinerlei Standards, keine einheitlichen Prozesse, keinerlei Vorgaben zum Umgang und zur Bewertung von Risiken gibt.

Mantel des Schweigens: Viele KI-Anwendungen der Sicherheitsbehörden bleiben intransparent

Darüber hinaus gibt es weitere Einschränkungen des parlamentarischen Fragerechts im grundrechtssensiblen Bereich: über ganze drei (!) Seiten erfolgte eine Rechtfertigung, in wieweit mir wegen potenzieller Gefährdung des Staatswohls viele Informationen zum Einsatz von KI in Strafverfolgungs-, Ermittlungs- und Gefahrenabwehrbehörden überhaupt nicht mitgeteilt werden können. Einige wenige (7) KI-Anwendungen dieser Sicherheitsbehörden wurden mir in eigestufter (VS-NfD) Form mitgeteilt, ich darf sie also nicht öffentlich diskutieren.

Zum Einsatz von KI bei den Geheimdiensten erfahre ich auch absolut gar nichts, dabei ist vermutlich dort das Risiko für Grundrechtsverletzungen und die Gefahr gravierender negativer Auswirkungen auf Individuen und die Gesellschaft durch einen Missbrauch besonders hoch. Eine sinnvolle parlamentarische Kontrolle ist so jedenfalls nicht möglich. Auch die immer wieder auch von der Ampel-Regierung propagierte offene Debatte zum Einsatz von KI durch staatliche Stellen und die Diskussion dazu, welche Risiken wir als Gesellschaft zu tragen bereit sind und welcher Nutzen dem dafür gegenüber stehen soll, kann es auch nicht geben.

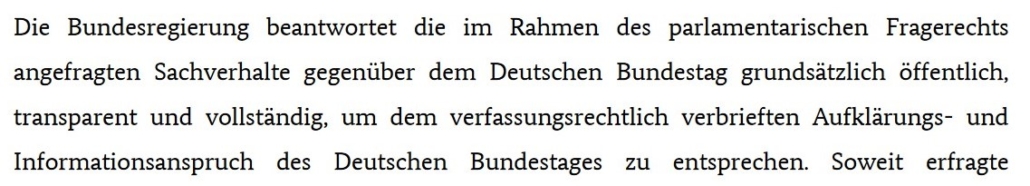

Abbildung 1: Ausschnitt aus den Vorbemerkungen der Bundesregierung zu ihrer Antwort

Statt “öffentlich, transparent und vollständig” dem “verfassungsrechtlich verbrieften Aufklärungs- und Informationsanspruch des Bundestages zu entsprechen”, wie die Ampel in ihrer Antwort offenbar ohne jede Ironie schreibt,

- Erfahre ich NICHTS über alle KI-Systeme beim Verfassungsschutz, BND und MAD

- Erfahre ich WENIG über die KI-Systeme bei ZITIS (Zentrale Stelle für Informationstechnik im Sicherheitsbereich, aka Hackerbehörde der Bundesregierung), BDBOS (Bundesanstalt für den Digitalfunk der Behörden und Organisationen mit Sicherheitsaufgaben), das BKA oder andere Sicherheitsbehörden. Und über einen Teil dieser Informationen darf ich nicht einmal öffenlich reden.

Wie groß der blinde Fleck ist, darf ich leider auch nicht wissen, denn ich habe die Bundesregierung in einer schriftlichen Frage gefragt, um wie viele KI-Anwendungen es sich dabei handelt, über die ich wegen potenzieller Staatswohlgefährdung keine Informationen erhalte. Und selbst diese Antwort, eine zusammengefasste Zahl, die nichts über den Zweck des KI-Systems und seinen Einsatz verraten hätte, wurde mir mit Verweis auf eine mögliche Staatswohlgefährdung verweigert (Link).

Der Mangel an wenigstens internen Strukturen und Standards, z.B. die weiter fehlende Bewertungsstelle für Algorithmen bei sicherheitsrelevanten Behörden wie Geheimdiensten und Polizei sind dabei besonders besorgniserregend. Gerade wenn Menschenrechte, das Recht auf Diskriminierungsfreiheit oder andere Grundrechte berührt sind, braucht es ein hohes Maß an Nachvollziehbarkeit und Überprüfbarkeit und Mindeststandards für vertrauenswürdige Checks and Balances, die bisher schlichtweg nicht etabliert werden. Wenn Sicherheitsbehörden jedoch Technologien wie Künstliche Intelligenz vermehrt einsetzen wollen, ohne dass es diese Checks and Balances gibt, steigen mit jedem Tag die Gefahren für einen Missbrauch oder Fehleinsatz von KI zum Nachteil der Öffentlichkeit. Die Versuchung wird hoch sein, also müssen es die Standards für Kontrolle und Transparenz auch sein.

Einsatz von KI im Hochrisikobereich Asyl und Migration

Besonders besorgniserregend sind in diesem Kontext auch die jüngsten Äußerungen von Kanzler Olaf Scholz, der sich einen vermehrten Einsatz Künstlicher Intelligenz bei Asylverfahren vorstellen kann (Link). Unklar bleibt, ob sich Olaf Scholz dabei neue bzw. weitere KI-Verfahren wünscht oder auf bereits bestehende Anwendungen bezog – denn das BAMF setzt seit mehreren Jahren KI bereits aktiv ein, wie meine Kleinen Anfragen und auch die Recherchen von Netzpolitik.org seit Jahren zeigen.

So verwendet das BAMF z.B. das sogenannte “Assistenzsystem, das Entscheidende dabei unterstützt, sicherheitsrelevante Sachverhalte zu erkennen, die an Sicherheitsbehörden weitergeleitet werden müssen.” Verständlicher formuliert werden durch die KI-Anwendung sog. Anhörungsprotokolle aus Asylverfahren und Befragungen erfasst, ausgewertet und gegebenenfalls Hinweise an Sicherheitsbehörden weitergegeben – ohne dass die Betroffenen darüber informiert werden. Doch die Systeme sind immer auch fehleranfällig, können erhebliche Auswirkungen für die Schutzbedürftigen haben – auch aufgrund eines automation sowie confirmation bias, die gewiss auch dort noch nicht ausgeschlossen werden können. Es zeigt sich eine eklatante Diskrepanz zwischen den formulierten Zielen und deren Umsetzung. Insbesondere in der Digitalpolitik klaffen auch bei der selbsternannten Fortschrittskoalition Anspruch und Wirklichkeit, Worte und Taten meilenweit auseinander. Beim Thema Künstliche Intelligenz scheint allein das Mantra „Digital first, Bedenken second“ zu gelten, wobei Milliarden an Steuergeldern ohne klare Regeln oder koordinierende Instanzen für KI-Vorhaben bereitgestellt werden – auch in sensiblen Bereichen, wo es hohe Schutzstandards statt freier Experimentierräume braucht.

3.4 Fortschritt bei Evaluationen, aber nicht genug

Zum KI-Hype gehört die Erwartung, dass man mit künstlicher Intelligenz auf einmal alle möglichen Probleme lösen kann. Die Technologie ist aber noch experimentell, vieles geht noch schief und viele Erwartungen werden nicht erfüllt. Die “Risiken und Nebenwirkungen” werden oft schlecht oder falsch eingeschätzt. Aus all diesen Gründen ist es besonders wichtig, jeden Einsatz von KI zu evaluieren, damit sicher gestellt ist, dass der Nutzen die möglichen unerwünschten Nebenwirkungen übersteigt, zu denen ja auch nicht nur Diskriminierungsfälle oder Grundrechtsverletzungen gehören, sondern z.B. auch der negative Klima-Impact, den die ressourcenfressenden KI-Systeme nun mal mit sich bringen.

Erfreulicherweise betont der BMI-Leitfaden zum Einsatz von KI sogar die Notwendigkeit einer Evaluation und nennt folgende zu evaluierende Aspekte:

- Erfüllung der Nutzungserwartungen,

- Überwachung rechtlicher Vorgaben,

- Einhaltung ethischer Anforderungen,

- Datenschutz,

- Transparenz und Verantwortlichkeit

- Fehleridentifikation und -behebung,

- Kosten-Nutzen-Analyse,

- Mitarbeiterakzeptanz und -schulung,

- Sicherstellung der Fairness

Evaluationen erfolgen vor allem intern – das ist ein Problem

Darüber hinaus ist ein Fortschritt, dass inzwischen bei fast drei Viertel (73 %) der KI-Anwendungen im Bund irgendeine Form der Evaluation vollzogen wird. Aber der Teufel steckt im Detail. So finden die Evaluationen überwiegend intern statt, z.B. durch die eigenen Fachtabteilungen und Projektbeteiligte, also oft durch die Nutzenden der KI-Anwendungen selbst. Selbstevaluationen sind aber nur mäßig sinnvoll, da man dabei weder Neutralität noch Objektivität sicher annehmen kann, was für eine gute Evaluation aber unbedingte Voraussetzung sein muss. Wie sollen verantwortungsvolle KI-Nutzung, Transparenz, Fehlersuche, Kosten-Nutzenanalysen, ethische Regelkonformität etc. durch interne Selbstevaluation sinnvoll möglich sein? Dafür braucht es geschulte Fachkräfte, z.B. des geplanten (immer noch nicht existierenden) Beratungszentrums für Künstliche Intelligenz, das bis vor Kurzem noch Beratungs- und Evaluationszentrum für Künstliche Intelligenz hieß. Warum wurde der Name von der Ampel geändert? Soll das BEKI keine Evaluationen mehr vornehmen, die nach standardisierten Prozessen ablaufen würden? Das wäre bedauerlich, denn das BEKI kann dafür genau die richtige Stelle sein, wenn es dafür auch die nötigen Ressourcen erhält.

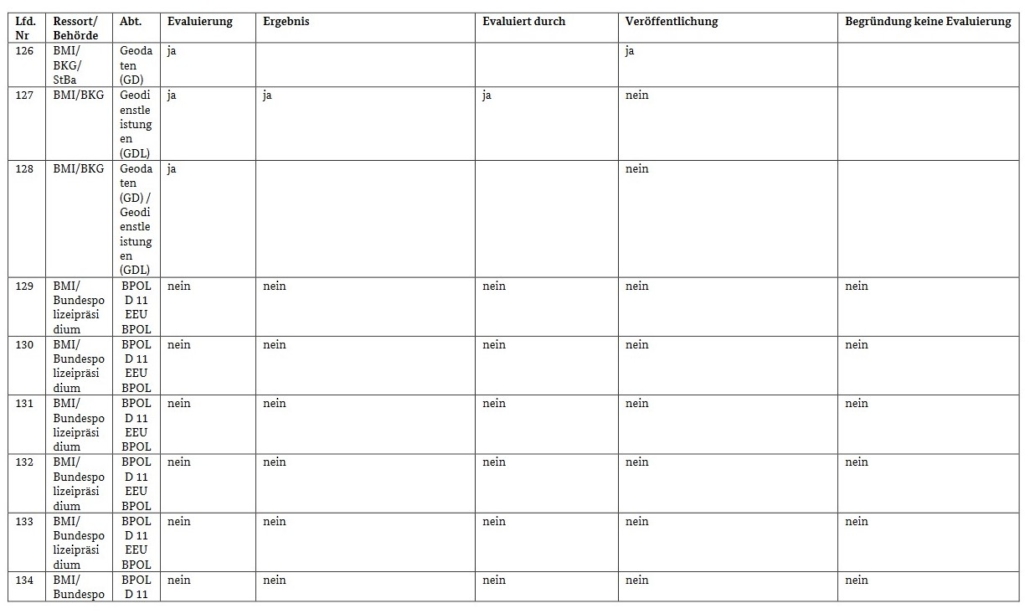

Zu oft keine Evaluation – vor allem im BMI

Bei immer etwa jedem 5. Einsatz von KI im Bund (19 %) fand keinerlei Evaluation statt. Besonders fällt auf und beunruhigt, dass fast jede zweite nicht evaluierte Anwendung (49 %) im BMI angesiedelt ist, wo viele grundrechtssensible KI-Einsätze stattfinden. Dazu zählen Anwendungen wie die Videodatenanalyse (Bundespolizei, Zeile 129, Anlage 1f) und die Sicherung und Aufbereitung für die Mobilfunkforensik und Cloudsicherung, wo KI eingesetzt wird, um “Massendaten zu sichten und zu kategorisieren” (Bundespolizei, Zeile 135, ebd.). Auf die Frage nach einer Begründung für die ausgebliebene-Evaluierung steht als Antwort ein schlichtes “Nein”. Bei der BKA KI-Anwendung zur Papillarleistenerkennung (Fingerabdruckerkennung) wurde die Antwort auf die Ja / Nein Frage nach Durchführung einer Evaluation einfach komplett verweigert, weil ein “öffentliches Bekanntwerden die Verwendbarkeit des Werkzeugs stark beeinträchtigen würde” (Zeile 145, ebd.). Da fehlen mir schon die Worte, denn wie soll ein Ja oder Nein auf die Evaluationsfrage die Verwendbarkeit der KI-Anwendung negativ beeinflussen? Die Frage nach “gab es ein Ergebnis der Evaluation wurde übrigens beantwortet – mit “Nein”.

Tabelle 7: Fehlende Evaluationen in BMI-Anwendungen – Auszug aus Anlage 1f

Für einen verantwortungsvollen Einsacht von Künstlicher Intelligenz innerhalb der Bundesverwaltung sind Audits bzw. Evaluationen unverzichtbar. Nur durch die Durchführung objektiver und umfassender Überprüfung der Systeme können die versprochenen Vorteile des Einsatzes realisiert und die möglichen Risiken minimiert werden. Daher fordere ich die Bundesregierung auf, sich endlich an die selbstgesteckten Ziele und die selbst erstellten Leitfäden zu halten und die dafür notwendigen Strukturen und Prozesse zu schaffen, um Transparenz, ethische Grundfragen und Risiken sowie die Nachvollziehbarkeit ihrer KI-Anwendungen sicherzustellen.

3.5 Mangelnde Transparenz

Die Nutzung von KI im Bund sollte besonders hohen Transparenzanforderungen genügen. Leider zeigt sowohl die fehlende Transparenz zum Einsatz von KI im Bund im Allgemeinen als auch die unvollständige Antwort der Ampel-Regierung auf meine Kleine Anfrage im Besonderen, wie groß die Defizite sind.

Wir brauchen eine einheitliche, einfach zugängliche und transparente Datenbasis über eingesetzte Algorithmen- und KI-Systeme in der öffentliche Verwaltung, z.B. damit die Überprüfung und Evaluierung möglicher Diskriminierungspotenziale, die Einhaltung (und Förderung) von Grundrechten genauso wie von Nachhaltigkeitskriterien oder schlicht Kontrolle und Bewertung durch die digitale Zivilgesellschaft, die freie Presse, sowie durch Forschende möglich sind.

Begrüßenswert sind die aktuellen Pläne des BMI, ein KI-(Transparenz) Register für Anwendungen des Staates aufzubauen. Dieses Register soll beim (immer noch nicht existierenden) Beratungszentrum für Künstliche Intelligenz (BEKI) angesiedelt werden, der künftig zentralen Koordinierungsstelle für KI im Bund. Ein solches Register muss verpflichtend für alle KI-Anwendungen im Bund sein, aber für KI-Anwendungen aller staatlichen Stellen in Deutschland (auch auf Länder- und kommunaler Ebene) geöffnet werden. Dafür sollte das BMI rechtzeitig in einen offenen Dialog unter Einbeziehung der Zivilgesellschaft und der Wissenschaft starten, um Bedarfe, Schnittstellen, Potenziale und Herausforderungen (z.B. Finanzierung) rechtzeitig zu adressieren. Im Ausland gibt es schon Erfahrungen, etwa in Helsinki (Link) sowie Amsterdam (Link), und auch in Deutschland gibt es bereits Konzepte (Link).

Ein „Marktplatz für KI-Anwendungen“ ersetzt kein KI-Register

Im BEKI soll es künftig auch einen “Marktplatz für KI-Anwendungen” geben, der offensichtliche Doppelentwicklungen verhindern und zum Kompetenzaustausch zwischen Behörden beitragen könnte. Aber ein KI-Transparenzregister ist so ein Marktplatz natürlich nicht und er kann auch keine Strukturen zum Kompetenzaufbau und zur Koordinierung ersetzen, die der Bundesrechnungshof bereits 2023 angemahnt hatte (Link). Außerdem sollte das künftige KI- Transparenzregister gerade auch solche KI-Anwendungen enthalten, die in Behörden und staatlich kontrollierten Organisationen eingesetzt werden, die Ordnungs- und Sicherheitsaufgaben wahrnehmen, also häufig qua Amt mit der Verletzung von Grundrechten zur Wahrung weiterer Grundrechte zu tun haben, aber ihre KI-Systeme sicher nicht auf einem Marktplatz für KI-Anwendungen teilen werden. Auf meine schriftliche Nachfrage erfuhr ich, dass der Start dieses KI-Marktplatzes für Herbst 2024 geplant sei (Link). Stand 01.11.24 gibt es von ihm noch keine Spur.

Jenseits der grundsätzlichen und allgemeinen Herstellung von struktureller Transparenz zum Einsatz von KI im Bund zeigt auch die vorliegende Antwort der Bundesregierung auf meine 3. Kleine Anfrage zu KI im Bund, dass es mit der Transparenz nicht weit her ist. Das wird einen Mix aus Gründen haben: fehlender Durchblick, überbordende Geheimniskrämerei, mangelnder Respekt gegenüber dem Parlament und schlichte Schlamperei – vielleicht auch Personalmangel und Überarbeitung, man steckt ja nicht drin.

Schlechtes Handwerk: lückenhaft, inkonsistent, an Fragen vorbei geantwortet

Die Antwort der Ampel hat jedenfalls erhebliche Lücken, ist in einigen Bereichen inkonsistent, lässt einige Fragen komplett unbeantwortet oder enthält Aussagen, die komplett an der Frage vorbei gehen. Manche Antworten sind trotz präziser Fragestellung so daneben, dass sie eine sinnvolle Auswertung verhindern, z.B. im Bereich der Risikoeinschätzung von KI-Systemen. Über Geheimdienste erfährt man gar nichts, über andere Behörden mit Sicherheitsaufgaben verstümmelte Antworten, Bullshit-Antworten oder als NfD eingestufte Antworten oder auch gar nichts, wegen vermeintlicher Staatswohlgefährdung. Mehrere Ministerien melden überhaupt keine KI-Anwendungen (BMFSFJ, BMWSB). Wie weiter oben bereits erwähnt, wurde mir selbst die Anzahl der eingesetzten und intransparent bleibenden KI-Systeme für die Behörden mit Sicherheitsaufgaben und Geheimdienste verweigert, weil selbst dadurch das Staatswohl in Gefahr sei (Link).

Das Militär: eine besonders finstere Blackbox

Das Verteidigungsressort mit dem größten IT-Bereich der gesamten Bundesregierung (im Kommando Cyber und Informationsraum arbeiten über 10.000 Fachleute) meldete eine einzige Anwendung und die ist als NfD eingestuft. Das überrascht vor allem deshalb, weil die Bundeswehr öffentlich frei über diverse KI-Anwendungen berichtet – z.B. auf dem Start Up Summit in Berlin 2024 oder auf ihrer Website, dort z.B. erfährt man über das KI-Labor der Bundeswehr (Link) von KI-Projekten wie „Voice Activity Detector“, „Sparrow Tracking“ und „CWBuddy“ (Link). Auch im aktuellen Haushaltsentwurf 2025 für das BMVg (Stand 01.11.24) sind in Titelgruppe 02 „Forschung, Entwicklung und Künstliche Intelligenz“ immerhin satte 795 Mio Euro vorgehen (Link). Auch im Cyber-Innovation-Hub der Bundeswehr laufen KI-Projekte wie z.B. „ImageAware“ (Link), die alles Andere als geheim sind. Ich habe deshalb eine Schriftliche Frage hinterhergeschickt und die Ampel mit diesem Widersprüchen konfrontiert.

IT-Auslagerung an GmbH als Ausrede für Intransparenz

Statt „sorry“ und mehr Informationen gab es darauf nur eine absurde Antwort der Bundesregierung (Link): Die erwähnten Aktivitäten liefen bei der BWI GmbH und damit nicht im Geschäftsbereich des BMVg, und deswegen könne man sich eine genauere Auskunft sparen. Die BWI GmbH gehört immerhin zu 100% dem Bund, dort arbeiten 7.000 Menschen und machen 1,5 Milliarden Euro Umsatz, ihre Selbstbezeichnung lautet: „Wir sind das IT-Systemhaus der Bundeswehr“. Es ist ziemlich wenig vertrauensbildend, null Transparenz zum Einsatz von KI zu schaffen, nur weil man sich einer staatseigenen GmbH bedient, um diesen Einsatz zu ermöglichen. Verwiesen wird auch darauf, dass die KI-Anwendungen, die ich über öffentliche Quellen fand, ja nur „im Rahmen von explorativem Lernen, Erproben und Entwickeln zum Zwecke des Erwerbs von Methoden-, Bewertungs- und Entscheidungskompetenz bei Innovationen, Analysen und Planungen dienen“ – na dann ist ja völlig egal, was man da so macht (WTF!). Übrigens sind militärische Anwendungen vom Geltungsbereich der KI-Verordnung komplett ausgenommen, weil für Verteidigungsfragen die Mitgliedsstaaten die Verantwortung tragen. Es gibt also nur dann Regeln für die Anwendung von KI im Militär, wenn die Bundesregierung sich selbst welche gibt. Das stimmt mich nicht gerade optimistisch.

Laut Digitalstrategie (Link) will sich die Ampel bis 2025 übrigens daran messen lassen, dass sie

“Kapazitäten und Fähigkeiten aufgebaut (ADB: hat), um Daten auf dem Gefechtsfeld schneller mit Hilfe von KI zu analysieren und damit die Effektivität auf dem Gefechtsfeld zu erhöhen.“

Abbildung 2: Auszug aus der Digitalstrategie der Bundesregierung:

60 Prozent KI-Systeme verschwieg der Bund in 2022. Heute? Unbekannt.

Stutzig wird man auch bei den Angaben aus dem Gesundheitsministerium, denn das Robert Koch-Institut meldete im vergangenen Jahr noch 8 KI-Anwendungen, in diesem Jahr jedoch keine einzige. Im Jahr 2022 hatte der Bundesrechnungshof festgestellt, dass die Bundesregierung in ihrer damaligen Antwort auf meine erste Anfrage zum Einsatz von KI im Bund etwa 60 % aller KI-Anwendungen “vergessen” hatte. Ich habe keine Möglichkeit festzustellen, wie hoch der Anteil der unterschlagenen KI-Anwendungen in diesem Jahr ist. Vielleicht ist er genauso hoch wie damals, dann gibt es möglicherweise schon 550 KI-Anwendungen im Bund, vielleicht ist auch nur das Dunkelfeld aufgehellt worden und der Anstieg von 86 KI-Anwendungen in 2022 auf mind. 219 in 2024 ist gar kein echtes Wachstum, denn mit den “verschwiegenen” Anwendungen wurden auch 2022 schon 215 KI-Systeme im Bund genutzt. Vermutlich liegt die Realität irgendwo in der Mitte – aber parlamentarische und öffentliche Kontrolle sollte nicht schätzen oder raten müssen, sondern klare Aussagen bekommen, sowohl was die nackte Anzahl eingesetzter KI-Systeme angeht (219 oder 550 oder noch mehr?), als auch was ihren Verwendungszweck, ihre Risikobewertung und viele andere Aspekte betrifft.

Vertrauen in den Einsatz einer mit hohen Chancen aber eben auch hohen Risiken behafteten Technologie baut man so nicht auf! Es ist eine der größten Schwächen der Ampel, dass sie zwar durchaus in diversen Strategien sinnvolle Ziele formuliert hatte, aber nicht ansatzweise in der Lage ist, die für die Umsetzung nötigen Voraussetzungen auch zu schaffen.

3.6 Nachhaltigkeit von KI spielt bei 3 von 4 Vorhaben überhaupt keine Rolle

KI-Systeme wachsen weltweit rasant, wodurch immer mehr und immer größere Rechenzentren entstehen, die riesige Mengen Wasser und eine exponentiell wachsende Menge erneuerbarer Energien verschlingen, die für andere Zwecke nicht mehr zur Verfügung steht, was den Ausstieg aus fossilen Energieträgern bremst. Ihre Hardware bindet außerdem Unmengen kritischer Rohstoffe, die in anderen Ländern z.T. unter fragwürdigen Umständen (Umwelt, Menschenrechte, Kinderarbeit…) gefördert werden und unsere Abhängigkeit erhöhen. Will man die Folgen der Klimakrise bekämpfen und die Umwelt schützen, muss der Einsatz von KI nachhaltig erfolgen.

Schon die GroKo verabschiedete ein Fünf-Punkte-Programm “KI für Umwelt und Klima” (Link), wonach der “Einsatz von KI-Technologien selbst klima- und umweltschonend erfolgen muss”, die Ampel kündigte in ihrer Digitalstrategie “Nachhaltigkeit by Design” an (Link) und das BMI versprach in seinen eigenen Leitlinien (Link) zum Einsatz von KI:

“Wir stellen stets Kosten und Nutzen von Anwendungen gegenüber. Dabei bewerten wir Nachhaltigkeit aus ökonomischer, ökologischer und organisatorischer Sicht”.

Nur 2% Förderungen mit umfassender Berücksichtigung ökol. Nachhaltigkeit

Diese Versprechungen haben mit der Realität einfach überhaupt nichts zu tun. Bei etwa 75 % der KI-Anwendungen im Bund werden ökologische Nachhaltigkeitsaspekte gar nicht berücksichtigt. Lediglich bei 2 % dieser knapp 219 Vorhaben wurden ökologische Nachhaltigkeitskriterien umfassend einbezogen. Selbst bei den vom Bund geförderten KI-Projekten spielt Nachhaltigkeit nur eine marginale Rolle. Wie will eine Regierung glaubwürdig ihre Forderung nach nachhaltigerem Einsatz von KI nach außen vertreten, wenn sie bei 98 Prozent der eigenen KI-Anwendungen selbst nicht hinreichend dafür sorgt? Man kann nicht Wasser predigen, aber Wein trinken, das führt zu Vertrauensverlusten, aber auch dazu, dass Unternehmen sich fragen, warum sie solchen Aufforderungen Folge leisten sollen, wenn es der Bund nicht mal selbst macht.

Enttäuschend ist dabei vor allem der Realitätscheck bei den beiden Ministerien, die sich ehrgeizige eigene KI-Leitlinien gegeben hatten. So hat das BMI, das laut eigenem Leitfaden “stets” Nachhaltigkeit beim KI-Einsatz berücksichtigen wollte, diesen Vorsatz in der eigenen Praxis bei 45 seiner 46 KI-Vorhaben (98%) komplett ignoriert, denn nur in einem einzigen Fall (BAMF) wurden Nachhaltigkeitsaspekte überhaupt betrachtet. Das BMDV wiederum schrieb sich in den eigenen Leitfaden: “Wir setzen auf nachhaltige KI-Lösungen”, aber tatsächlich spielten Nachhaltigkeitskriterien nur bei einem von 30 KI-Vorhaben (3%) tatsächlich eine Rolle und das war beim Deutschen Wetterdienst, der KI übrigens zur Simulation von Klimamodellen und zur Prognose schwerer Unwetterlagen verwendet.

Totalausfall: Klima- und Umweltministerium

Die beiden Ministerien mit Verantwortung für Umwelt und Klima sind leider ganz und gar keine Vorbilder. Das BMWK interessiert sich nicht mal, jedenfalls weiß man im Klimaministerium bei jedem vierten KI-Einsatz (11 der insgesamt 44 KI-Vorhaben) in seinem Geschäftsbereich nicht einmal, ob Nachhaltigkeit betrachtet wurde oder nicht, bei weiteren 31 KI-Vorhaben war die Antwort einfach “Nein”. Die Bilanz des Klimaministeriums bei seinen eigenen KI-Projekten ist daher bei 95 Prozent der Vorhaben (42 von 44) “keine Ahnung” oder “Nachhaltigkeit nicht betrachtet”. Ich wüsste schon gern, was Minister Habeck dazu sagt, ich vermute, dass er das nicht einmal weiß. Auch das Umweltministerium hat bei 11 KI-Projekten im eigenen Haus nur zwei mal Nachhaltigkeitskriterien berücksichtigt, und das ist erschütternd schlecht, denn das BMUV ist auch für das Thema Green IT im Bund zuständig.

Ökologische Nachhaltigkeit: keine Förderbedingung bei 98% der KI-Förderprojekte!

Aus dem Kopfschütteln kommt man aber erst recht nicht mehr raus, wenn man dann noch lesen muss, dass der Bund selbst bei der Vergabe von Fördergeldern nicht steuernd gewirkt hat, denn bei 98 Prozent der vom Bund seit Jan. 2023 geförderten KI-Forschungsprojektewar ökologische Nachhaltigkeit keinerlei Förderbedingung und bei über 80 Prozent der geförderten KI-Projekte war sie nicht einmal ein Förderkritierium, sondern spielte einfach überhaupt keine Rolle! Solche Zahlen lassen mich ehrlich gesagt ratlos zurück. Gerade wenn Millionen Euro ausgegeben werden, muss der Staat seiner Verantwortung gerecht werden und diese Mittel auch so ausgeben, dass sie das fördern, was auch langfristig für die Gesellschaft sinnvoll ist. Dazu gehört, KI-Systeme nur dann finanziell zu fördern, wenn sie auch in Sachen Nachhaltigkeit innovativ sind, denn so kann die Marktmacht des Staates gemeinwohlorientierten Innovationen einen Wettbewerbsvorteil verschaffen, der ihre Verbreitung unterstützt und sowohl einen direkten als auch einen indirekten Beitrag zur Erreichung der Klimaziele leisten.

4. Fazit und Forderungen aus Linker Sicht

Das Fazit ist klar, vermutlich wird immer mehr KI im Bund eingesetzt, ohne die dafür erforderliche Sorgfalt, ohne die notwendigen Standards und Prozesse, ohne hilfreiche Strukturen, ohne hinreichend Kompetenz bei Anwender:innen und Entscheider:innen, ohne öffentliche Debatte und die dafür benötigte Transparenz. Daraus ergeben sich vier grundlegende Forderungen.

Was es aus linker Sicht braucht:

- Schere schließen zwischen “Immer mehr Einsatz von KI” bei “weiterhin fehlenden Supportstrukturen u ohne zentrale Koordinierung, ungenügendem Kompetenzaufbau”

- Stelle für zentrale Koordinierung einrichten

- Support-Strukturen aufbauen! BEKI, Algorithmen-Bewertungsstelle für Behörden mit Sicherheitsaufgaben und hinreichend ausstatten mit Ressourcen

- Kompetenzaufbau: Kein Einsatz ohne Schulung!

- Verbindliche Prozesse und Standards für Auswahl, Einsatz, Evaluierung von KI-Systemen, zum Beispiel:

- Risikobewertung, vor jedem Einsatz, mit standardisiertem Risikoklassenmodell, nicht ohne Schulung, und nicht durch Anwender:innen selbst

- Evaluation, immer – während und nach jedem Einsatz, nach einheitlichen Qualitätsstandards, nicht durch Anwender:innen selbst

- Gemeinwohlorientierung im Vordergrund, insbesondere Klimawirkung einbeziehen

- Nachhaltigkeit als relevantes Entscheidungskriterium bei Einsatz im Bund und bei Förderprojekten

- Prüfen der Erforderlichkeit der KI-Anwendung anhand der Bedeutung erwartbarer gesellschaftlicher Fortschritte in Abwägung zu Ressourcenverbrauch (Rohstoffe, Energie), Treibhauseffekt, Steuergeldverbrauch und Lösungsalternativen wie Software mit regelbasierten Algorithmen

- Maximale Transparenz: Öffentliches Register für KI Einsatz durch den Staat zeitnah umsetzen

- Offene, gesellschaftliche Debatte! – nur so sind Vertrauen und Akzeptanz möglich

- Keine Blackbox für besonders grundrechtssensible Bereiche!

Bereits zum dritten Mal in Folge hat meine Kleine Anfrage einen Beitrag zur dringend notwendigen Transparenz in die KI-Anwendungspraxis der Bundesregierung geleistet. Es ist vermutlich meine letzte, denn die Ampel ist in Auflösung begriffen und dem nächsten Bundestag gehöre ich nicht mehr an. Ich hoffe, es wird sich trotzdem endlich viel verbessern!

Herzlichen Glückwunsch und ein Dankeschön an alle, die bis hier diesen sehr langen Text gelesen haben. Mein Team und ich haben viel Arbeit in diese Analyse gesteckt und schätzen die Aufmerksamkeit für dieses wichtige Thema. Sollte es Fragen und/oder Hinweise dazu geben, stehen wir unter anke.domscheit-berg@bundestag.de gerne zur Verfügung.